与人类相比,人们更喜欢被人工智能 "统治":研究

人工智能最初比人类的判断更受信任,但人类的决定更受青睐。

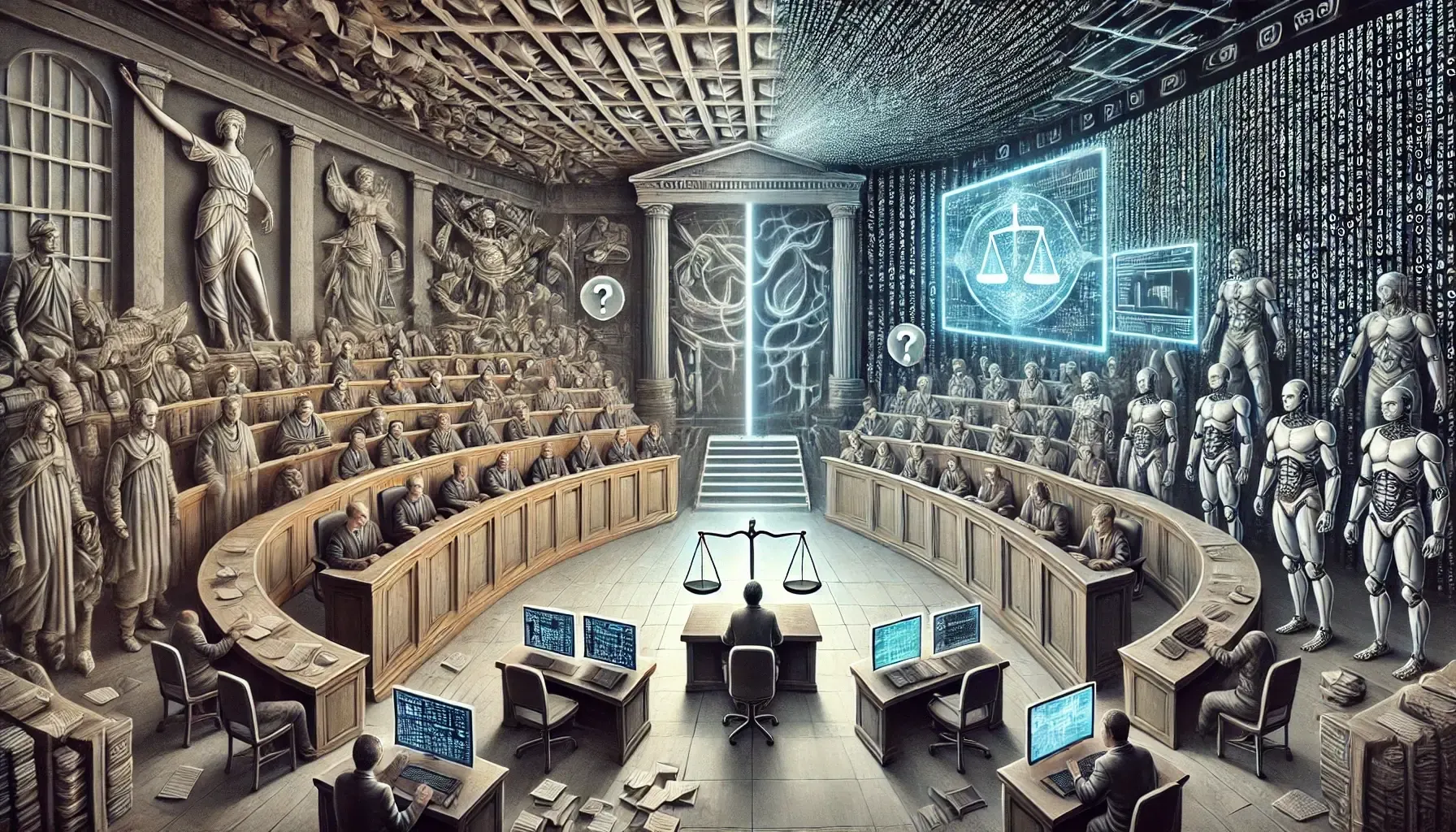

一项新的研究揭示了人类与机器之争中一个意想不到的转折:人们更喜欢人工智能的裁决,而不是人类的裁决--至少在对金钱问题做出艰难决定时是这样。但是,在交出我们的财务钥匙之前,一些严重的红旗正在招展。

玛丽娜-丘古诺娃(Marina Chugunova)和沃尔夫冈-J-卢汉(Wolfgang J. Luhan)周二公布了一项名为 "机器人统治 "的研究。科学家们发现,超过 60% 的参与者赞成由人工智能决策者来重新分配收入。为什么呢?这与避免人类偏见无关--人们只是认为机器会发挥公平作用。

"该研究称:"实验在一个基于几百人所持公平原则的公平算法和一个被要求做出公平决定的人类(决策者)之间做出了选择。"在没有群体成员信息的情况下,63.25%的选择都会优先选择算法"。

即使引入了偏见的可能性,这种偏好也保持稳定。

但关键在于:虽然人们喜欢人工智能发号施令的想法,但他们对人类做出的决定评价更高。

"研究称:"人们对算法决策的满意度较低,他们认为算法决策不如人类决策公平。

这项研究的设置非常巧妙。参与者在人类决策者和人工智能决策者之间做出选择,以瓜分来自运气、努力和天赋任务的收益。即使当每组的成员都被揭露出来,有可能为歧视打开大门时,人们仍然倾向于人工智能。

"卢汉在一份新闻稿中说:"许多公司已经在使用人工智能进行招聘决策和薪酬规划,公共机构也在警务和假释策略中使用人工智能。"我们的研究结果表明,随着算法一致性的提高,公众可能会越来越支持算法决策者,即使是在道德意义重大的领域。"

这不仅仅是学术界的异想天开。随着人工智能悄然进入生活的更多领域--想想从人力资源到约会等任何领域--我们如何看待其公平性,可能会决定公众对人工智能驱动政策的支持与否。

然而,人工智能在公平性方面的记录可谓乏善可陈。

最近的调查和研究揭示了人工智能系统中持续存在的偏见问题。早在 2022 年,英国信息专员办公室就对人工智能驱动的歧视案件展开了调查,研究人员也证明,最受欢迎的法律硕士具有明显的政治偏见。埃隆-马斯克(Elon Musk)的x.AI公司专门指示Grok避免给出 "清醒 "的答案。

更糟糕的是,牛津大学、斯坦福大学和芝加哥大学的研究人员进行的一项研究发现,人工智能模型更有可能建议对说非裔美国人英语的被告判处死刑。

人工智能求职?研究人员发现,人工智能模型抛出了听起来像黑人的名字,并偏爱亚洲女性。"据彭博科技报道,"与名字与其他种族和族裔相关的简历相比,名字与美国黑人截然不同的简历最不可能被列为金融分析师职位的最佳人选。

卡斯-R-桑斯坦(Cass R. Sunstein)在他所定义的人工智能驱动的 "选择引擎 "方面所做的工作描绘了一幅类似的图景,表明虽然人工智能有可能增强决策,但它也可能放大现有的偏见或被既得利益所操纵。"无论是否具有家长作风,人工智能都可能会受到自身行为偏见的影响。有证据表明,LLMs 也会表现出人类的一些偏见,"他说。

不过,博-考吉尔和凯瑟琳-塔克等一些研究人员认为,人工乐虎国际手机版下载被视为各方的中立之地,这巩固了人工乐虎国际手机版下载在决策时的公平形象。"他们在 2020 年的一篇研究论文中指出:"算法偏见可能比人类偏见更容易衡量和解决。

换句话说,一旦部署,人工智能似乎更可控、更合乎逻辑--如果它偏离了自己的目标,也更容易调节。这种完全无视中间人的理念是智能合约背后哲学的关键:自动执行的合约可以自主运作,无需法官、托管人或人类评估者。

一些加速论者认为,人工智能政府是实现全球社会公平与效率的一条可行之路。然而,这可能会导致一种新形式的 "深层国家"--不是由阴暗的寡头控制,而是由这些人工智能系统的设计者和训练者控制。

编辑:Ryan Ozawa

Related News

- Mena Suvari 因 Gala 电影科幻系列获得艾美奖提名

- 比特币批评者参议员梅嫩德斯因贪污被定罪将退出国会

- 诊断出 Covid 后,拜登退出 Polymarket 的几率飙升至 66

- Notcoin "玩家在 Telegram 游戏 "Pixelverse "和 "Musk Empire "中获得独家特权

- Ethereum Creator Vitalik Buterin Rattles Industry After Warning of Pro-Crypto Candidates

- 灰度以太坊迷你 ETF 从美国证券交易委员会获得绿灯

- 随着 ETF 的逼近和奖励的增加,以太坊估值接近历史最高点

- 亚马逊的人工智能应用程序生成器承诺提供无需 "专业开发人员 "的工具

- 比特币财政公司 DeFi Technologies 第三季度大幅盈利后,股价暴涨 25

- 尼日利亚狱医在被拘留的 Binance 高管案中面临逮捕

© 2025 DeFi.io